Rzeczywistość rozszerzona – koktajl rzeczywistości z wirtualnością

Niektóre stare pomysły VR plus nowe techniki wyświetlania obrazu, wiele postępów w technologii mobilnej i nie tylko? Opcjonalny? dokładna lokalizacja satelity lub pobranie kodu. Mieszamy, mieszamy i mamy? Rozszerzona Rzeczywistość? Rozszerzona Rzeczywistość.

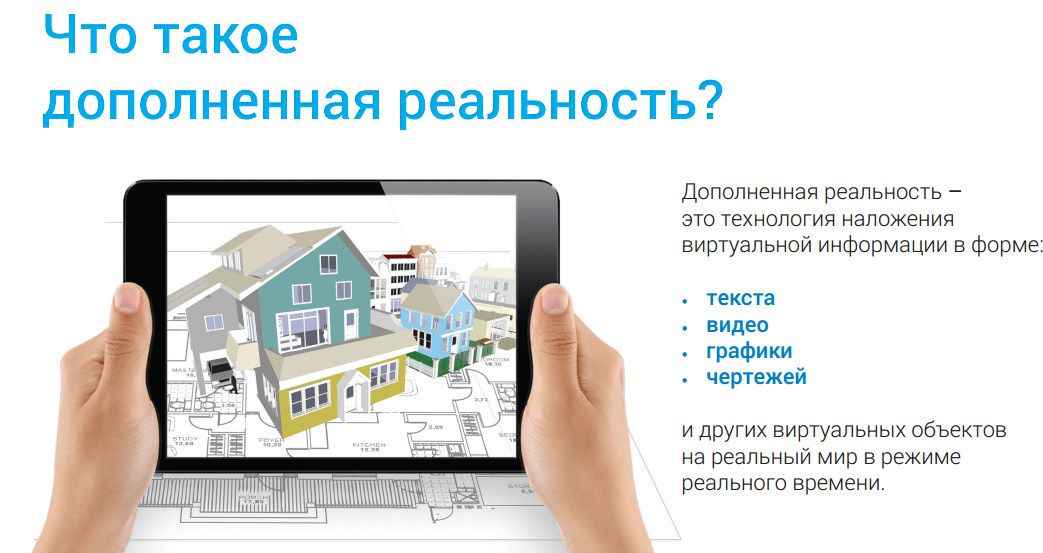

Czym ona właściwie jest? W skrócie można ją opisać jako nieco starą, nieco nową technikę łączenia świata rzeczywistego z obiektami wirtualnymi. Integralnym elementem współczesnej rzeczywistości rozszerzonej jest interakcja człowieka zarówno z rzeczywistym światem zewnętrznym, jak i z maszyną, ponieważ w AR maszyna znacząco wpływa na postrzegany przez nas obraz rzeczywistości. Modyfikuje go, uzupełnia o informacje z systemów komputerowych i baz danych, a w niektórych przypadkach dane o historii interakcji z danym obiektem, miejscem, fragmentem rzeczywistości. Interakcja zarówno nasza, jak i innych użytkowników sieci ludzkiej.

Dobrze znanym przykładem technologii rozszerzonej rzeczywistości jest wprowadzony wiosną 2012 roku Google Glass, a także inne wynalazki tego typu, jak np. Smart Glasses firmy Vuzzix. Ideą jest wykorzystanie półprzezroczystych okularów do obserwacji życia na ulicach miasta, a także wygenerowanych komputerowo elementów i obiektów nałożonych na obraz rzeczywistości.

Okulary, a kto wie, może w przyszłości soczewki kontaktowe, a nawet implanty poszerzające rzeczywistość na miarę ludzkich potrzeb, to wciąż bardziej zapowiedź niż rzeczywistość. Premiera rynkowa okularów Google planowana jest na rok 2014. Obecnie poza dość poważnymi zastosowaniami w medycynie czy lotnictwie, z AR najczęściej spotykają się użytkownicy urządzeń przenośnych, smartfonów, tabletów czy konsol do gier.

Rzeczywistość + Lokalizacja + Obiekty wirtualne = AR

Jak łatwo zauważyć, rzeczywistość rozszerzona nie jest nową technologią, a raczej pomysłem na połączenie kilku znanych od dawna technik. Celem tego połączenia jest dostarczenie użytkownikowi dodatkowych informacji i doświadczeń związanych z miejscem, w którym się znajduje lub oglądanym obiektem. Kolejnym celem jest umożliwienie mu interakcji z obiektami wirtualnymi lub innymi odbiorcami rzeczywistości rozszerzonej.

Przyjrzyjmy się, jak to działa na typowym tablecie lub telefonie wyposażonym w aplikację do renderowania (czyli prezentowania danych w formie odpowiedniej dla otoczenia – w tym przypadku wizualnej) wirtualnych obiektów, które uzupełniają obraz postrzegany przez właściciela urządzenia (1 ) .

Jak widać obraz wchodzący do obiektywu aparatu jest odbierany przez mechanizm rozszerzonej rzeczywistości jako „ciało stałe”. czyli komórka rozciągająca się od obiektywu aparatu do powierzchni obrazu obiektów uchwyconych przez kamerę, w kształcie mniej lub bardziej ściętej piramidy. Treść ta musi być wypełniona obiektami wirtualnymi pochodzącymi z informacji o lokalizacji odbiorcy z bazy danych na serwerach sieciowych.

Solidne meble? informacje i twory z bazy danych nie zajmują dużo czasu, ale może to zająć naprawdę dużo czasu, jeśli masz słabe mobilne połączenie internetowe. Ponieważ zależy to tylko od tego, czy rzeczywistość rozszerzona w czasie rzeczywistym jest rzeczywistością, czy też jej rozwijanie jest wyczerpująco długim procesem.

Powstał w ten sposób ?com? pełen dodatkowych informacji, tagów, w niektórych przypadkach obrazów? rekomendacje czy komentarze innych użytkowników aplikacji pojawiają się na wyświetlaczu, gdzie nakładają się na obraz z kamery, podobnie jak w okularach Google, z tą różnicą, że w projekcie Glass postrzegamy rzeczywistość bez użycia aparatu (2). Efekt końcowy widzimy na smartfonie lub tablecie w postaci obrazu wypełnionego dodatkowymi danymi w postaci np. kolorowych okienek danych, jak w aplikacji stworzonej specjalnie dla osób zajmujących się lub zainteresowanych nieruchomościami w mieście (3).

Znajdziesz kontynuację tego artykułu w marcowym numerze magazynu

Katalog IKEA 2013 z rozszerzoną rzeczywistością [NIEMIECKI]